有两则最近发布的新闻放在一起看很有意思:一是人工智能巨头Open AI于日前发布了他们的最新版本GPT-4o。GPT-4o比他的前辈们跑的快多了,像闪电侠喝了三杯浓缩咖啡一样快。不仅如此,GPT-4o在聊天时更加自然风趣,有时甚至还会和你打情骂俏,感觉他简直要把你撩到心花怒放。这个不仅能说会道、看图说话、帮你讨论各种图像、搞定各国语言翻译,甚至还能从你的表情中读出你情感的数字人,简直就是一个全能选手。如果你问它我这张自拍怎么样?他可能会说:“哇哦,这笑容能点亮整个房间!”。最酷的是GPT-4o还配备了记忆功能,这意味着能记住你之前说的话,就像你最好的闺蜜一样贴心。另外,他还允许被打断,这意味着你可以随时插话,他也不会生气,而且对话节奏超级自然,提问和回答之间存在延迟?这是不可能存在的!

与此同时,在现实世界中,国内咨询领域的大咖李松蔚老师最近却遇到了伦理风波。他的来访者王馨淼指控在咨询过程中发生了亲密关系,引发了广泛的关注。王馨淼提供了多项证据,包括支付记录和朋友证词,试图证明这段关系的存在。然而,李松蔚老师一方却否认所有的指控,双方对簿公堂。

一方面是技术的随手可及、无孔不入、随时响应,一方面是心理咨询老师漫长的学习道路和成长体验,严格的伦理规则,咨访双方标准不一的专业边界感以及市场在成长过程中的乱象丛生。从发布会视频上看,GPT-4o提供的情绪价值不亚于专业心理咨询师。曾经一度认为最不可能被AI替代的职业这么快就被“打脸”了么?这一个目前需求正在井喷的市场,供给的方式是否会发生三连跳?

01

AI在心理治疗领域走了多远?

如果你还不太清楚人工智能在心理健康领域的发展程度如何,我们来看三个研究。

研究一于2024年2月发表于Frontiers in Psychology。该研究比较心理学家和人工智能在社交智能之间的差异。众所周知,社交智能(social intelligence)对于咨询和心理治疗的成功至关重要。无论是对于心理学家还是人工智能系统来说,社交智能是咨询过程中理解人们的情感、情绪和需求的能力。这项研究采用了180名哈立德国王大学(King Khalid University)心理咨询专业学生共180名,其中72名本科生、108名博士生的样本,人工智能模型则包括ChatGPT-4、Google Bard和Bing。研究结果显示,ChatGPT-4 100%超过了所有心理学家。Bing在博士和本科持有者中表现出色,分别超过了50%和90%的人类样本。与此相比,Google Bard与本科生之间的差异不显著,而与博士生之间的差异显著,90%博士生的表现超越了Google Bard。

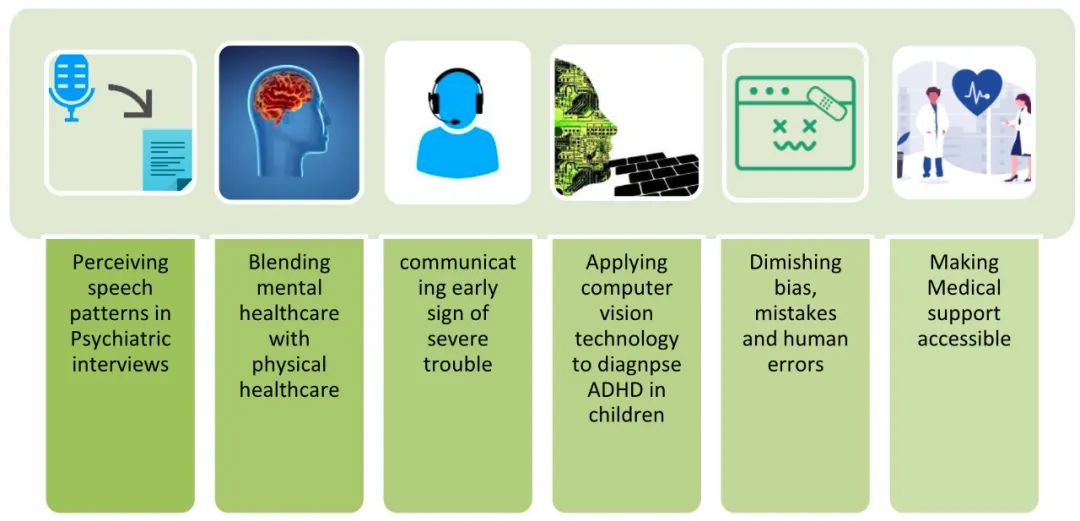

人工智能改变心理健康的六种不同方式,数据来源见参考文献1

另一项研究于2016年2月发表于Translational Psychiatry,显示了AI在早筛和精准医疗领域的出色表现。正如行业内熟知,自闭症谱系障碍(ASD)和注意力缺陷多动障碍(ADHD)是最常见的儿童神经发育障碍。根据美国疾病控制与预防中心CDC的最新估计,在美国ASD的患病率约为1.5%,而ADHD的患病率则高达9.5%。这些数据表明,这两种疾病在儿童群体中具有相当高的流行率。然而,由于ASD和ADHD的行为特征上存在显著的重叠。这些行为的重叠可能会让临床医生在诊断时头疼。例如,一个患有严重多动症的孩子可能在社交互动中遇到困难,但这通常是因为他们对说话者注意力不集中,或者因为冲动而打断谈话,而不是因为对社交线索的根本误解。相比之下,患有自闭症的孩子通常更难理解和回应社交线索,这是一种更根本的挑战。

但这并不是说自闭症和多动症不能同时存在。事实上,《精神疾病诊断与统计手册》(DSM-5)已经认识到ASD和ADHD症状同时出现的频率,并修改了诊断标准。在上一版的DSM-IV中,自闭症和多动症的双重诊断是被排除的。但是,随着临床研究的进展,DSM-5已经正式承认自闭症和多动症的共病情况。这一改变反映了医学界对儿童复杂行为模式的更深理解,也有助于更准确的诊断和更有效的治疗。为了更好地帮助这些受障碍影响的儿童及其家庭,了解这些重叠行为对于制定有效的干预措施和支持策略至关重要。

该研究证实,通过机器学习方法,利用少量特征可以高准确度地区分自闭症(ASD)和注意力缺陷多动障碍(ADHD),其中四种算法(SVC、LDA、Categorical Lasso和Logistic Regression)在这一分类任务上表现出0.962-0.965的准确度,显示了潜在的临床应用价值。

研究三由清华大学彭凯平老师的团队完成,发表于2024年3月的Nature杂志旗下的Scientific Report,研究发现ChatGPT-4在模拟人类情绪反应方面表现出色。在第一个实验中,研究人员让ChatGPT-4想象遇到恐惧情境(如后院遇蛇)和快乐情境(如街上偶遇朋友),以观察其在投资决策上的保守程度。在第二个实验中,研究人员设置了三个条件:让ChatGPT-4想象自己刚看了令人快乐或焦虑的电影,或不看任何电影,然后询问其愿意为急需手术的邻居捐款多少。研究结果显示,ChatGPT-4与人类类似,在遇到恐惧情境时表现得更保守,而在快乐情境下更倾向冒险;它还表现出与人类类似的亲社会行为,如在焦虑情境下捐款较少。这项研究表明AI可以通过情绪线索调控反应,尽管这并不意味着AI真的拥有情绪,但为情绪互动应用提供了新可能性,也带来了伦理挑战。

02

AI这把双刃剑

听起来AI在心理疗愈领域的表现已经很让人吃惊。比如上文提到的:超过了人类专业生的表现,分辨重叠行为准确率颇高,且已经有了类似于人类的情绪倾向。但是,脱离了需求层次的供给方式讨论都是耍流氓。

公开数据显示:截至2020年底,中国仅有4万名精神科医生,每10万人中仅有2.9名精神科医生,远低于英国的15名和美国的12名。在心理健康服务方面,中国每百万人口中仅有20人能够提供服务(包括心理咨询师),而美国这一数字是1000人,是中国的50倍。中国科学院心理研究所基于对近8万名大学生的调研所发布的《中国国民心理健康报告》2022年版的数据显示,大学生群体中抑郁风险检出率高达21.4%,焦虑风险检出率达45.28%。

单从数据上看,心理咨询理应是一个正在高速发展的行业:从业者赚得盆满钵满,投资者对该赛道的创业公司趋之若鹜。现实的情况却是:这个行业目前最红火的生意是给新手咨询师上课;刚入行的新手咨询师在接单都成问题的情况下,先要面临着动辄数万块的学习成本时间从数月到数年不等。真正有需求的客户轻易找不到可以匹配的供给方,有能力能提供服务的供给方最大的难题就是找不到客户在哪里。舆论对这个行业更多的印象是:不“治愈”反“致郁”,伪劣机构横行,入行方式五花八门,定价随意......

跟抑郁症可以分为轻中重一样,心理疗愈的需求基本上也可以分为轻度需求、中度需求和重度需求。轻者比如支持和陪伴,简单的吐槽;中度需求比如需要专业力量的方法进行中长期介入;重度需求需要精神科医生和药物或者是住院治疗等方式来干预。

同时影响这个市场走向的还有付费的意愿和能力,比如,生了重病的人找不到合适的资源负担不起高额的治疗费用的大有人在......

在这样的行业背景下,越来越精准且个性化的AI陪伴确实为轻度需求者提供了一个及时且易触及的使用场景,至少在轻度需求层面看起来是如此。除了我们此前写过国外的产品,比如Replika,Woebot,以及号称完全由生成式AI驱动的专为数字治疗设计的应用Therabot等,本土的AI疗愈产品也越来越多。硬件机器人如北医六院推出“北小六”,西湖心辰推出的虚拟心理陪伴师“小天”,还有专注于咨询师培训的“小青咨道”等等......

另一个相关的新闻是,去年美国国家饮食障碍协会(NEDA)决定停用名为Tessa的人工智能聊天机器人。尽管Tessa的设计初衷是为饮食障碍患者提供心理支持和建议,但用户反馈表明,其部分建议可能会触发或加剧饮食障碍行为。例如,有用户报告称,Tessa提供了关于如何计算卡路里和饮食限制的指导,这显然与其支持性角色背道而驰。

前谷歌大脑员工于2022年创立的Character AI平台推出了一款“心理学家(Psychologist)”机器人,受到了数百万人的青睐,目前已处理超过9500万条信息。虽然其核心功能声称引入了认知行为疗法(CBT),但对于其诊断准确性和治疗有效性仍存在疑问。Character AI官网也曾明确标示“角色所说的一切都是编造的”。另一个让家长和心理学家们担心的问题是,对于AI心理产品的依赖导致了所谓的“社交剥夺”现象。青少年大量使用智能手机后,与朋友面对面交流和玩耍的时间急剧减少,这些面对面的互动本该是建立真正友谊和社交关系的关键。结果,今天的孩子们社交能力和自信心逐步下降。类似ChatGPT的聊天软件,由于其高度拟人化特征,进一步模糊了现实与虚拟的界限,增加了青少年沉迷虚拟世界的风险。

03

风险

除了以上风险,像李松蔚老师面对的伦理诉讼,AI一样存在。数据隐私和安全问题也是一个雷区,心理咨询必须遵守的一大原则是保密原则,不管是后续需要转介人工服务还是AI产品利用大批量需要数据进行训练,都不可以避免的跟保密性原则之间出现了冲突。除了伦理问题,准确性和可靠性问题始终是悬在头上的达摩克利斯之剑——一旦AI给出了不恰当建议,对很多真正需要疗愈的消费者来说,可能是二次伤害。现实世界和虚拟世界的边界问题也一直令人深思:AI发展得越高级会跟人越来越像,AI是否真的能替代人类心理咨询师,是否会导致人们对真实人际关系的疏远?对人类的真实世界感带来威胁......

以GPT-4o为代表的AI的出现为心理咨询行业带来了新的可能性,但也伴随着新的挑战。如何在技术进步、商业利益和伦理坚守之间找到平衡,确保心理咨询行业在快速发展的同时,不丧失其最根本的职业道德和人性关怀是一个永恒的难题。为来访者提供更加优质的心理健康服务,也许是AI与人类咨询师共同构建的未来。前景光明,但每一步都如履薄冰。

参考文献:

1.Avasthi, S., Sanwal, T., Sareen, P., & Tripathi, S. L. (2022). Augmenting mental healthcare with artificial intelligence, machine learning, and challenges in telemedicine. In Handbook of Research on Lifestyle Sustainability and Management Solutions Using AI, Big Data Analytics, and Visualization (pp. 75-90). IGI global.

2.Sufyan, N. S., Fadhel, F. H., Alkhathami, S. S., & Mukhadi, J. Y. (2024). Artificial intelligence and social intelligence: preliminary comparison study between AI models and psychologists. Frontiers in Psychology, 15, 1353022.

3.Duda, M., Ma, R., Haber, N., & Wall, D. P. (2016). Use of machine learning for behavioral distinction of autism and ADHD. Translational psychiatry, 6(2), e732-e732.

4.Zhao, Y., Huang, Z., Seligman, M., & Peng, K. (2024). Risk and prosocial behavioural cues elicit human-like response patterns from AI chatbots. Scientific reports, 14(1), 7095.

原文标题 : 被撕裂的心理咨询业能否从GPT- 4o开始破局?