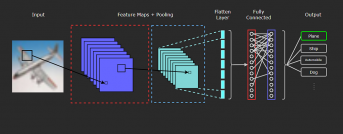

3. 基于梯度的方法3.1 显著性图正如我们在坦克的例子中所看到的,我们如何才能知道我们的模型关注哪个部分来获得预测?为此,我们可以使用显著性图。使用显著性图的概念是非常直接的——我们计算输出类别相对于输入图像的梯度,这可以告诉我们输出类别值相对于输入图像像素的微小变化是如何变化的。梯度中的所有正值都告诉我们,对该像素的微小更改将增加输出值,因此,将这些与图像形状相同的梯度可视化,应该能提供一些直觉。直观地,该方法突出了对输出贡献最大的显著图像区域。class_idx = 0indices = np.where(val_y[:, class_idx] == 1.)[0]

# 从这里选取一些随机输入。idx = indices[0]

# 让sanity检查选中的图像。from matplotlib import pyplot as plt%matplotlib inlineplt.rcParams['figure.figsize'] = (18, 6)

plt.imshow(val_x[idx][..., 0])

from vis.visualization import visualize_saliencyfrom vis.utils import utilsfrom keras import activations

# 按名称搜索图层索引# 或者,我们可以将其指定为-1,因为它对应于最后一层。layer_idx = utils.find_layer_idx(model, 'preds')

# 用线性层替换softmaxmodel.layers[layer_idx].activation = activations.linearmodel = utils.apply_modifications(model)

grads = visualize_saliency(model, layer_idx, filter_indices=class_idx, seed_input=val_x[idx])# 可视化为热图。plt.imshow(grads, cmap='jet')

# 线性层。for class_idx in np.arange(10): indices = np.where(val_y[:, class_idx] == 1.)[0] idx = indices[0]

f, ax = plt.subplots(1, 4) ax[0].imshow(val_x[idx][..., 0])

for i, modifier in enumerate([None, 'guided', 'relu']): grads = visualize_saliency(model, layer_idx, filter_indices=class_idx, seed_input=val_x[idx], backprop_modifier=modifier) if modifier is None: modifier = 'vanilla' ax[i+1].set_title(modifier) ax[i+1].imshow(grads, cmap='jet')

3.2 基于梯度的类激活图类激活图是另一种在进行预测时可视化模型所看到内容的方法,使用倒数第二卷积层输出,而不是使用相对于输出的梯度,这样做是为了利用存储在倒数第二层的空间信息。from vis.visualization import visualize_cam

# 线性层。for class_idx in np.arange(10): indices = np.where(val_y[:, class_idx] == 1.)[0] idx = indices[0]

f, ax = plt.subplots(1, 4) ax[0].imshow(val_x[idx][..., 0])

for i, modifier in enumerate([None, 'guided', 'relu']): grads = visualize_cam(model, layer_idx, filter_indices=class_idx, seed_input=val_x[idx], backprop_modifier=modifier) if modifier is None: modifier = 'vanilla' ax[i+1].set_title(modifier) ax[i+1].imshow(grads, cmap='jet')

结尾在本文中,我们介绍了如何可视化CNN模型,以及为什么要可视化,我们结合一个例子来实现它。参考链接:https://www.analyticsvidhya.com/blog/2018/03/essentials-of-deep-learning-visualizing-convolutional-neural-networks/

☆ END ☆