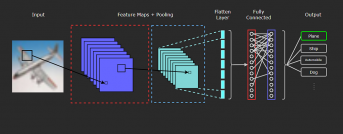

在图像任务中卷积网络通常将输入图像编码成一系列中间特征来捕捉图像局部和全局的语意信息,特征的空间分辨率也会随着层数的增加而减小。然而,这种以牺牲空间分辨率为代价的模型结构对于需要多尺度特征的识别任务来说并不能获取非常有效的特征,尤其像是目标检测和语意分割任务中,类别识别和目标定位同样重要。像FCN和DeepLab等工作都提出了多尺度的编解码器架构来解决这一问题,利用牺牲尺度的模型来作为编码器,同时利用解码器来恢复空间信息。

虽然这种架构成功地提升了识别和定位任务的性能,但使用了降采样的编码器依旧损失了空间信息,需要解码器进行恢复,但这种恢复无法保留足够的原始空间信息。人们不禁想到,如果可以设计出一种主干模型避免空间信息的损失,是不是就能天然地同时适应于图像识别与定位任务了?

几种不同的尺度轮换架构

在这种思想的指导下,研究人员在今年的CVPR论文SpineNet中提出了一种名为尺度轮换模型(scale-permuted)的元结构,从两个方面提升了主干结构的性能。中间特征图的空间分辨率应该可以在任意层提升或者减小,以便在网络加深时保持空间信息的有效性;其次特征图间的连接应该跨越特征尺度来促进多尺度信息的融合。在新架构下,研究人员利用了神经架构搜索(Neural Architecture Search,NAS)方法在新的搜索空间中寻找有效的尺度轮换模型。结果表明这种模型在多尺度视觉任务中超过了标准的尺度缩减主干网络,在多个基准上实现了优异性能指标。

左图显示了尺度缩减结构,右图显示了尺度置换主干网络。每个矩形表示了一个模块,颜色和尺寸显示了空间分辨率和特征维度的变化,箭头表示了不同层间的连接。

一、SpineNet的架构设计

为了高效地设计SpingNet的架构,避免耗时的手工设计、参数搜索和设计,研究人员设计了NAS来优化模型结构。主干模型在COCO数据集上进行了训练,同时强化了识别和定位任务的需求。在架构搜索阶段,研究人员主要在三个方面进行了处理:

尺度轮换:由于需要从已有的模块进行构建,网络模块的顺序十分重要。在搜索中通过重整中间特征和输出模块的序列关系来重新定义了尺度轮换空间。交叉尺度连接:为每个模块定义了两个输出连接,可以来自于任意的低层模块或主干网络模块。模块自适应(可选):模块可以自适应地调节其尺度和种类。

从尺度缩减到尺度轮换的架构搜索过程对比

NAS搜索中使用了ResNet-50 主干网络来作为搜索种子,首先学习了尺度轮换和交叉连接的方式。研究人员使用了基于递归神经网络的控制器来实现架构搜索,这是目前最适合于尺度轮换的搜索架构。为了加速搜索过程,研究人员还设计了SpineNet代理,将SpineNet- 49的特征维度缩减因子设置为0.25,设置重采样因子α为0.25,并在bbox检测和分类中使用了64维的特征。为了防止搜索空间的指数增加,研究人员限制了中间架构仅仅允许最后五个block搜索,并在在现有block中进行检索。针对每个样本,代理训练512分辨率的图像5个epoch,同时验证集上的AP被作为奖励来优化结构。实际中使用了100个TPU来运行,来搜索最好的结构。