前不久墨西哥的7.4级地震,再次让我们感受到了人类在自然灾害面前的渺小。天灾难以避免,但灾后及时的应急响应能够很大程度地减少损失。在此过程中,超高分辨率卫星就扮演着愈发重要的角色。不过,高清卫星图像依旧需要密集的人力来识别灾情,这远远满足不了应急响应的需求。

本文将分享谷歌研究人员如何利用机器学习的方法自动检测建筑物并评测损害程度。这一技术有望提高灾后报告的生成速度,帮助救灾团队按照受灾程度展开救援。

人类的历史很大程度上是与自然灾害斗争的历史!从远古的大洪水时代到近年的大地震、从肆虐的台风到暴雨洪水,大范围的自然灾害影响着成千上万人的生命财产安全。在灾难发生时,大规模、有效的、及时、准确的应急响应对于救灾来说至关重要。政府、公益组织、国际组织需要快速翔实地了解灾区情况并依此制定有效的救助计划来优化资源配置,最大程度的减少损失。

近年来具有0.3m分辨率的超高分辨率卫星在灾难响应中扮演着越来越重要的角色,为有关部门和决策者提供了前所未有的翔实视觉信息,包括地形地貌、城市建筑受灾情况甚至人口受灾变化等都能得到丰富的信息。

然而即使有了高清卫星图像,还是需要密集的人力来从图像中识别出灾情:倒塌的建筑、垮塌的桥梁、临时帐篷的位置和数量等等,都需要专家从图像中识别出来。例如2010年海地大地震时,分析员手工查阅了太子港地区超过90000栋建筑的情况并进行受灾评估,整个过程耗费了专家团队几个星期的时间。而最需要灾情信息的是震后48-72小时,需要丰富的灾情信息来进行救灾决策和计划制定,仅靠人类进行大规模的灾情分析远远满足不了应急响应的需求。

为了提高对于灾害应急响应能力,来自谷歌的研究人员构建了一种基于卷积神经网络进行受损建筑物检测的有效方法,将利用机器学习的方法自动检测建筑物并评测损害程度。这一技术将有望提升灾后报告的生成速度,同时减少救灾部署的时间,帮助救灾团队按照轻重缓急的展开救援。下图显示了整套系统的数据处理流程。

具体方法

自动灾情评估的实现过程主要分为两部分,分别是建筑物检测和受损分类。研究人员利用目标检测方法来从卫星图像中检测出每栋建筑物的区域。随后抽取每栋建筑物区域灾前和灾后的图像进行处理,利用分类模型来分析建筑物是否受损。

分类模型由卷积神经网网络构成,其输入为灾前灾后两张161x161像素的RGB图像,对应着地面上以建筑为中心50mx50m的区域。模型将分析两张图形的异同并输出0.0-1.0之间的分数,其中0分代表建筑没有损坏,1.0分代表建筑被自然灾害损坏了。

在针对两幅输入图像的处理,研究人员提出了四种不同的模型架构,要么在前端对输入图像叠加输入,要么分离获取特征图随后再对其中的结果进行处理。上述的四种结构中CC代表了将灾前和灾后图像叠加输入,PO代表了只输入灾后图像,TTC代表了分别获取灾前灾后图像的特征图而后叠加处理,TTS代表了将灾前灾后的特征图进行相减而后叠加处理。几种结构的性能如下图所示,使用了TTS作为最终的架构。

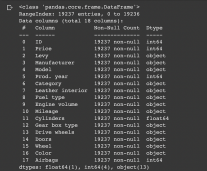

由于两张图像的拍摄时间和每天的日照时间不同,甚至由不同的卫星拍摄,因此需要对图像的颜色、光强和饱和度进行矫正,对像素进行对齐。为了校正颜色和光照的不同,研究人员利用直方图均衡的方法来处理震前和震后的图像。同时使用了标准的数据增强策略来使模型对于不同条件下的光照光强变得更为鲁棒。