图|语音发展史

语音识别产品应用

语音识别作为打造良好交互体验的重要前提,今年的发展可谓是持续火爆。在智能音箱市场,首先想到的就是Amazon的Echo。Echo作为将自然语音转化为在线指令的设备,其效率之高无容置疑,并且可保持在线的自然环境中的自然语言识别。

Echo的核心技术在于它集成的智能语音助手Alexa。在2015年6月25日亚马逊曾宣布,将开放智能语音硬件Echo的内置AI助手Alexa的语音技术,供第三方开发者免费使用。由此可见,亚马逊向用户呈现出来的不仅仅是技术上的领先,还有真正落地的产品,以及良好的产品体验。

与此同时,国内语音识别领域也开始争夺大战。以科大讯飞听见系列产品为例,自2015年发布以来,总用户突破1000万,应用于30余个行业。目前,已经形成了以听见智能会议系统、讯(询)问笔录系统、听见转写网站、录音宝APP、听见智能会议服务等以智能语音转写技术为核心的产品和服务体系。

语音识别技术瓶颈

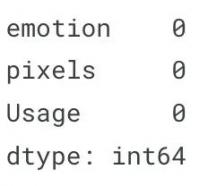

从下图可以看出,语音识别的误字率呈明显的下降趋势。

然而,即使达到100%的准确率,仅限于输入法功用的语音识别也无人机互动的意义,它还算不得真正的人工智能。

我们所期望的语音识别实质上是人机交互,大致上可以理解为人与机器之间无障碍沟通。要达到这种期望,光靠误字率很低甚至为零的语音识别可能并不能做到,那么就需要有“大脑”的语义识别了,相对于语音识别,它可以通过人们的语气、谈话的内容等等判断用户说的话到底是什么意思,而不是简单的一字不落的识别出所说的内容。比如说:小沈阳长得可真帅!在不同的语境下却有着截然相反的意思。

从“傻白甜”的语音识别到“带脑子”的语义识别,还有很长的路要走。

口音和噪声

语音识别中最明显的一个缺陷就是对口音和背景噪声的处理。最直接的原因是大部分的训练数据都是高信噪比、美式口音的英语。

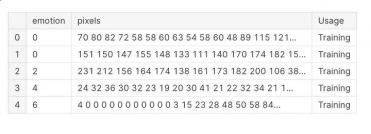

上图中可以看到有口音的情况下,人的错误率低于模型;从高信噪比到低信噪比,人与模型之间的错误率差距急剧扩大。

语义错误

实际上语音识别系统的目标并不是误字率。人们更关心的是语义错误率。

举个语义错误的例子,比如某人说“let’smeetupTuesday”,但语音识别预测为“let’smeetuptoday”。我们也可能在单词错误的情况下保持语义正确,比如语音识别器漏掉了“up”而预测为“let’smeetTuesday”,这样话语的语义是不变的。

将模型与人工进行比较时的重点是查找错误的本质,而不仅仅是将误字率作为一个决定性的数字。

微软研究人员将他们的人工级语音识别器的错误与人类进行过比较。他们发现的一个差异是该模型比人更频繁地混淆“uh”和“uhhuh”。而这两条术语的语义大不相同:“uh”只是个填充词,而“uhhuh”是一个反向确认。这个模型和人出现了许多相同类型的错误。